Dans la tempête du développement et du déploiement de l'intelligence artificielle, un fait est clair : les systèmes d'IA ont tendance à refléter le monde dans lequel nous vivons déjà, amplifiant les inégalités sociales existantes et aggravant la marginalisation historique de certains groupes.

Vous avez peut-être déjà entendu l'aphorisme selon lequel l'IA est seulement aussi bonne que les données sur lesquelles elle est entraînée – et bien sûr, ces données sont tirées de la vie réelle, du monde imparfait et en constante évolution dans lequel nous vivons. Il en va de même pour la conception, le développement et la gouvernance de l'IA, où des lacunes et des préjudices historiques persistent. Chaque phase du cycle de vie des systèmes d'IA, si elle n'est pas clairement axée sur l'égalité, pourrait exacerber les disparités existantes, à la fois dans les pays et entre les pays.

Bien que la plupart des gens reconnaissent que tou·te·s devrait bénéficier du développement de l'IA, l'action vers une plus grande égalité dans les écosystèmes de l'IA est l'un des domaines de la gouvernance de l'IA qui reçoit le moins d'investissements. Il est absolument nécessaire d'agir et d'établir un cadre mondial robuste pour permettre aux décideur·euse·s politiques de promouvoir l'égalité des genres et la diversité en IA.

Perspectives et recommandations pour une politique d'IA transformatrice

Afin de traiter les causes sous-jacentes des inégalités en matière d'IA, nous devons agir pour inverser l'exclusion historique des individus et des communautés. C'est dans ce but que le groupe de travail sur l'IA responsable du Global Partnership on AI (GPAI), soutenu par Mila - Institut québécois d'intelligence artificielle et par le CEIMIA, a produit un rapport intitulé « Vers une réelle égalité en intelligence artificielle: une politique d’IA transformatrice pour l’égalité des genres et la diversité », ainsi qu'un guide d'accompagnement pour aider les décideur·euse·s politiques à mettre en œuvre les recommandations du rapport.

Basés sur des consultations approfondies avec plus de 200 participant·e·s issu·e·s de plus de 50 pays et représentant un large éventail de communautés, d'identités et de domaines d'expertise, le rapport et le guide politique appellent à une véritable égalité en IA. Ensemble, ils offrent des perspectives politiques, des exemples de pratiques prometteuses et des recommandations concrètes, ainsi qu'une feuille de route détaillée pour la mise en œuvre de ces recommandations. Toutes ces recommandations sont basées sur les droits humains et mettent l'accent sur l'égalité des genres et la diversité.

Examinons quelques-unes des principales recommandations du rapport et du guide politique.

Égaliser le terrain de jeu : Conception inclusive et innovation démocratique

Dans nos réflexions sur le développement inclusif de l'IA, nous devons changer de paradigme : il ne suffit pas simplement d'« ajouter » des groupes marginalisés aux discussions sur l'IA. Il faut plutôt décentrer l'IA elle-même et centrer les communautés grâce à des pratiques de conception inclusive et d'innovation démocratique afin de remédier aux désavantages systémiques auxquels sont confrontés les femmes et d'autres groupes marginalisés pour participer au développement de technologies nécessaires.

Il existe des moyens concrets pour les décideur·euse·s politiques de contribuer à ce processus de réelle inclusion, en investissant dans le renforcement des capacités des institutions, en autorisant le traitement de catégories spéciales de données ou en finançant la recherche et la conception de technologies transformatrices.

Un exemple de conception inclusive en action est le Feminist AI Research Network (f<A+i>r), une initiative de près de 100 chercheuses, activistes et professionnelles féministes en IA issues de différents domaines, qui défendent le partage de connaissances multidisciplinaires et l'innovation féministe à l'échelle mondiale. Cette approche est à la fois axée sur la communauté tout en étant technologiquement avancée et innovante. Le réseau fournit des données, des algorithmes, des modèles, des politiques et des systèmes nouveaux qui peuvent servir à corriger les préjudices et les obstacles réels aux droits, à la représentation et à l'égalité des femmes et d'autres groupes marginalisés.

D'un point de vue politique, il est essentiel de financer et de soutenir de telles initiatives et, par extension, le développement et la mise en œuvre de systèmes et de processus d'IA inclusifs. Nous devons créer les conditions permettant aux personnes et aux communautés traditionnellement exclues de participer de manière significative aux processus d'IA en tant qu'acteurs centraux. L'implication active et intentionnelle des communautés marginalisées dans chaque phase du développement, du déploiement et de la gouvernance de l'IA est essentielle pour garantir que l'IA soit bénéfique pour toutes et tous.

Qui a son mot à dire ? Une participation active à la gouvernance de l'IA

Le simple fait d'avoir accès à l'IA ne signifie pas nécessairement que les femmes et les autres groupes marginalisés peuvent participer à son développement et à sa gouvernance. Une approche de l'IA centrée sur les droits humains exige que les personnes aient réellement leur mot à dire dans le développement et le déploiement de technologies qui peuvent avoir un impact profond sur leur vie. Les décisions concernant l'IA ont un impact sur tout le monde et doivent donc refléter les valeurs et les priorités de toutes les communautés, en particulier celles qui sont historiquement exclues. Cela nécessite un engagement public actif, un renforcement des capacités des groupes marginalisés et des protections juridiques pour les droits de participation du public et les droits sur les données collectives.

Historiquement, des obstacles systémiques ont limité la croissance professionnelle des communautés marginalisées, le développement de leurs compétences et leur sensibilisation à l'IA et à d'autres technologies émergentes auparavant. Ces obstacles sont la conséquence d'inégalités économiques, de l'accès limité aux possibilités de formation, d'une infrastructure numérique inadéquate et de barrières culturelles. Heureusement, de nombreuses initiatives s'efforcent de réduire ces barrières à l'innovation démocratique et à la participation active à la gouvernance de l'IA.

L'une de ces initiatives, le programme Éclaireurs autochtones en IA, menée par Mila - Institut québécois d'intelligence artificielle en partenariat avec Indspire, est une initiative de développement de carrière qui crée les conditions permettant aux talents autochtones de façonner l'avenir de l'IA. Axé sur les perspectives et les valeurs autochtones relatives au développement de l'IA, le programme permet aux communautés autochtones d'orienter ce développement d'une manière qui leur soit bénéfique.

Les leçons tirées de cette initiative sont importantes pour comprendre comment les communautés et les cultures autochtones du monde entier peuvent contribuer de manière unique au développement de technologies d'IA qui reflètent leurs visions du monde. Les décideur·euse·s politiques peuvent œuvrer à une gouvernance de l'IA plus inclusive en organisant des séances de sensibilisation et de consultation avec les groupes marginalisés afin de comprendre leurs priorités et leurs besoins spécifiques et d'élaborer des politiques pour y répondre. Forts de ces perspectives, ils peuvent ensuite financer et soutenir des initiatives éducatives, professionnelles et financières qui permettent aux communautés marginalisées de participer de manière concrète aux écosystèmes de l'IA et d'y jouer un rôle de premier plan, ainsi que de développer leurs propres technologies d'IA.

Bâtir la confiance : Transparence, responsabilité et accès à la justice

Dans le contexte actuel de l'IA, la transparence, la responsabilité et l'accès à la justice sont indispensables dans les processus et les prises de décision liés à l'IA. Il est essentiel de veiller à ce que des cadres solides soient mis en place pour prévenir les préjudices et les discriminations liés à l'IA. Cependant, il faut également mettre en place des mécanismes en cas de défaillance de ces cadres afin d'établir la confiance dans l'IA et d'en exploiter les avantages. Si des communautés sont exclues, blessées ou discriminées par des systèmes d'IA - de manière accidentelle ou intentionnelle - elles doivent disposer de ressources juridiques et de moyens d'action pour remédier au problème.

La transparence et la responsabilité contribuent à l'égalité réelle en nous permettant d'auditer les systèmes en place. Si nous pouvons examiner publiquement les systèmes et les processus d'IA, détecter les préjugés et tenir les fournisseurs privés et publics responsables des effets indésirables, nous aurons une bien meilleure visibilité sur les enjeux en question. Cela nous permettra de défendre l'égalité et de corriger les exclusions structurelles de manière informée et cohérente. Le rapport et le guide politique présentent plusieurs recommandations visant à améliorer la transparence et la responsabilité. Il s'agit notamment de garantir le droit à l'information, d'améliorer la transparence des algorithmes, de réaliser des évaluations d'impact sur les droits humains et d'établir des lignes directrices pour les marchés publics tout au long du cycle de vie de l'IA.

Un exemple pratique dont nous pouvons nous inspirer est l'Indice mondial de l'IA responsable, une initiative qui analyse les politiques d'IA et les engagements nationaux des pays pour promouvoir l'inclusivité, la responsabilité et l'éthique dans l'IA. Cet outil collaboratif détaillé et ses points de référence fournissent des données représentatives aux décideur·euse·s politiques, aux chercheur·euse·s et aux journalistes, leur permettant de suivre et de mesurer les progrès réalisés par les pays pour défendre les droits humains dans le domaine de l'IA. À leur tour, les décideur·euse·s politiques du monde entier peuvent utiliser ces critères pour élaborer des réglementations qui imposent la transparence dans les opérations d'IA et définissent des procédures de responsabilisation afin de garantir une utilisation responsable et inclusive de l'IA. Une fois que nous disposons des données et que nous les avons transformées en idées, il est temps de passer à l'action.

Une feuille de route pour une réelle égalité dans les écosystèmes d'IA

Pour que l'IA puisse bénéficier à tout le monde, les systèmes d'IA doivent être conçus de manière inclusive, gouvernés démocratiquement et dotés de procédures de responsabilité et de justice permettant de réparer les dommages potentiels. Avec un nombre impressionnant d'initiatives défendant ces causes, il est clair que les gouvernements ont la responsabilité de développer des politiques d'IA transformatrices pour s'assurer que l'écosystème de l'IA ne reproduit pas les inégalités à l'intérieur et entre les pays. Nous passons maintenant à ce qui sera sans doute le plus difficile : passer à l'action.

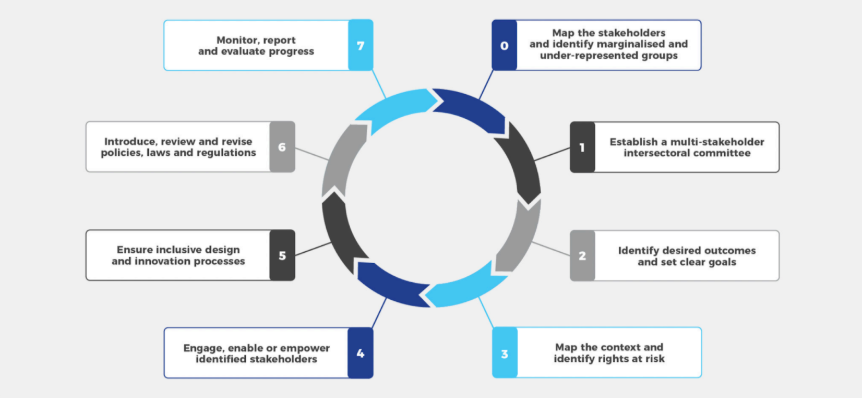

À juste titre, de nombreux acteurs pourraient se sentir incertains de la procédure à suivre face à cette technologie naissante et en évolution fulgurante. C'est là qu'une feuille de route détaillée, comme celle fournie dans le Guide d’application des recommandations de la politique d’IA transformatrice, sera utile.

La mise en pratique de ces idées politiques et leur intégration dans les réglementations et législations mondiales nécessiteront une coordination importante. Les institutions du monde entier devront investir dans ces domaines pour permettre une IA juste. Cela peut prendre plusieurs formes : investir dans leurs propres capacités et dans le renforcement des capacités des autres ; investir dans les individus, dans la formation, dans la création d'institutions ; ou encore définir les droits et les responsabilités des institutions pour permettre l'accès à la justice. Les bacs à sable réglementaires publics sont également des moyens utiles pour favoriser une innovation sécuritaire : ils nous permettent d'effectuer des tests itératifs afin d'équilibrer les contrôles technologiques et la mise en place de limites réglementaires claires.

Certes, il n'existe pas de solution simple pour rendre les écosystèmes d'IA plus responsables, plus équitables et plus inclusifs. Les recommandations du rapport et du guide politique du GPAI sont également destinées à être adaptées et appliquées en fonction du contexte, qu'il soit géographique, social, culturel, historique, économique, juridique ou politique. Les mesures que les parties prenantes peuvent raisonnablement adopter varieront énormément en fonction des cadres juridiques et réglementaires, des capacités techniques, de la disponibilité des ressources et de la coopération entre les acteurs, ainsi que d'autres obstacles à la mise en œuvre, spécifiques à la communauté.

Pour concrétiser cette vision, nous devons soutenir les initiatives locales tout en encourageant la collaboration internationale. Il est nécessaire d'échanger avec diverses parties prenantes mondiales pour élaborer des politiques inclusives capables de s'adapter au rythme rapide des progrès de l'IA. Par conséquent, les acteurs mondiaux doivent rechercher et amplifier les voix de la majorité mondiale et veiller à ce qu'elles fassent partie intégrante de la gouvernance de l'IA. En donnant la priorité à l'équité et à l'inclusion, nous pouvons exploiter le pouvoir de l'IA pour créer un avenir plus juste et plus équitable pour toutes et pour tous.

Cet article a initialement été publié sur le blog AI Wonk de l'OCDE.