Recurrent Batch Normalization

Posted on30/03/2016

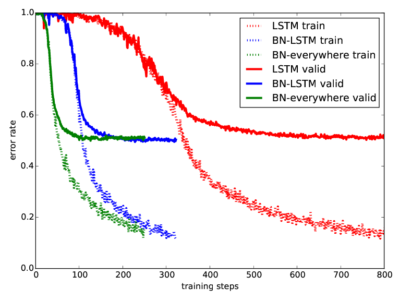

Nous proposons un reparamétrage de LSTM qui apporte les avantages de la normalisation par lots aux réseaux de neurones récurrents. Alors que... En savoir plus

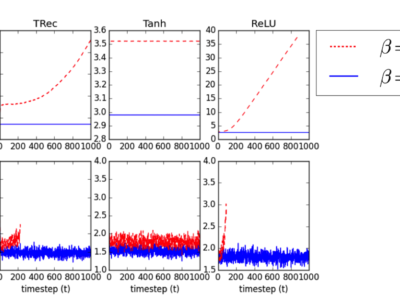

Regularizing RNNs by Stabilizing Activations

Posted on24/11/2015

Nous stabilisons les activations des réseaux de neurones récurrents (RNN) en pénalisant la distance au carré entre les normes d’états cachés successifs.... En savoir plus

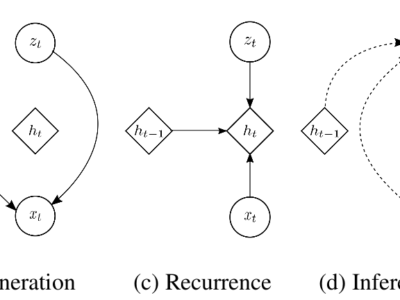

A Recurrent Latent Variable Model for Sequential Data

Posted on07/06/2015

Dans cet article, nous explorons l’inclusion de variables aléatoires dans l’état caché dynamique d’un réseau de neurones récurrent (RNN) en combinant des... En savoir plus