Towards Lossless Encoding of Sentences

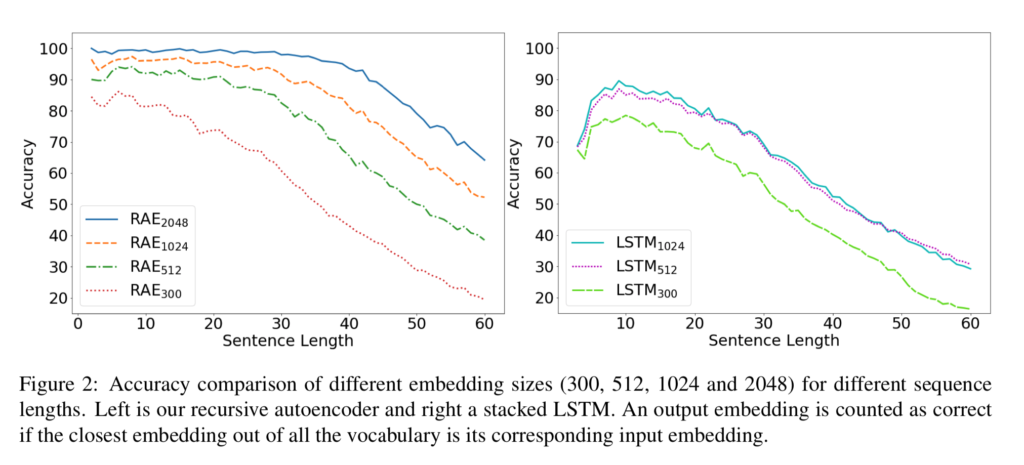

Beaucoup de travail a été fait dans le domaine de la compression d’images via l’apprentissage automatique, mais la compression du langage naturel n’a pas fait l’objet d’une grande attention. Compresser du texte en représentations sans perte tout en rendant les fonctionnalités facilement récupérables n’est pas une tâche facile, mais présente d’énormes avantages. La plupart des méthodes conçues pour produire des incorporations de phrases riches en fonctionnalités sont uniquement axées sur l’exécution de tâches en aval et ne permettent pas de reconstruire correctement la séquence d’origine à partir de l’intégration. Dans ce travail, nous proposons une méthode presque sans perte pour coder de longues séquences de textes ainsi que toutes leurs sous-séquences en représentations riches en fonctionnalités. Nous testons notre méthode sur l’analyse des sentiments et montrons de bonnes performances pour toutes les combinaisons de phrases.

Reference

https://arxiv.org/abs/1906.01659