State-Reification Networks: Improving Generalization by Modeling the Distribution of Hidden Representations

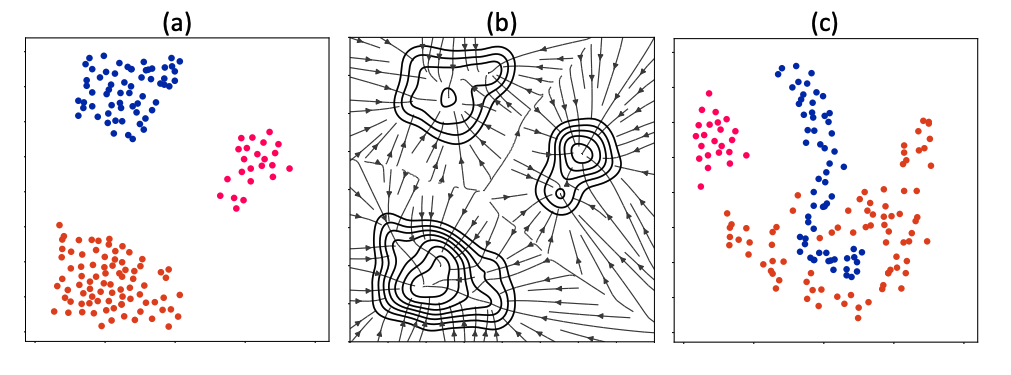

L’apprentissage automatique promet des méthodes qui se généralisent bien à partir de données étiquetées finies. Cependant, la fragilité des approches de réseaux neuronaux existantes est révélée par des échecs notables, tels que l’existence d’exemples contradictoires mal classés, bien qu’ils soient presque identiques à un exemple de formation, ou l’incapacité des réseaux de traitement séquentiel récurrent de rester sur la bonne voie sans l’intervention forcé du professeur. Nous introduisons une méthode, que nous appelons \ emph {state reification}, qui consiste à modéliser la distribution des états cachés sur les données d’apprentissage puis à projeter les états cachés observés lors des tests en vue de cette distribution. Notre intuition est que, si le réseau peut rester dans une multitude d’espaces cachés bien connue, les couches suivantes du réseau devraient être bien formées pour pouvoir réagir correctement. Nous montrons que cette méthode de réification d’état aide les réseaux de neurones à généraliser mieux, en particulier lorsque les données étiquetées sont rares, et aide également à surmonter le défi de la généralisation robuste avec une formation contradictoire.