Learning Disentangled Representations with Semi-Supervised Deep Generative Models

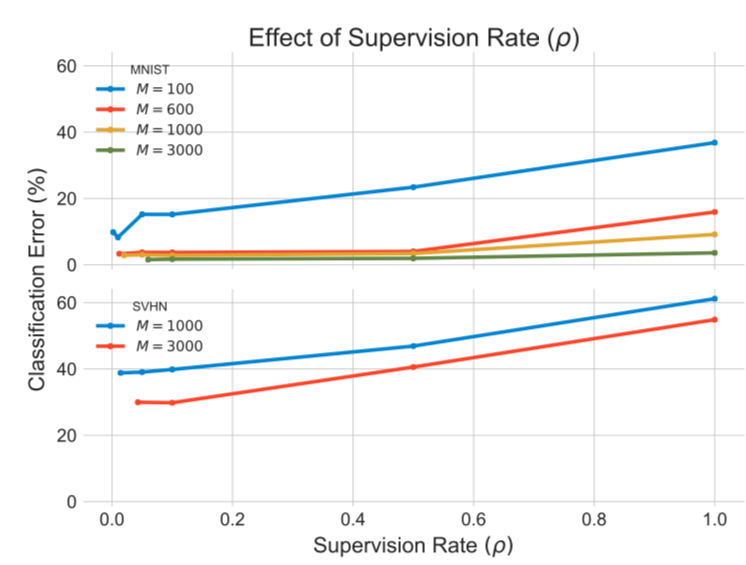

Les auto-encodeurs variationnels (VAE) apprennent des représentations de données en formant conjointement un réseau de codeurs et de décodeurs probabilistes. Généralement, ces modèles encodent toutes les caractéristiques des données dans une seule variable. Nous nous intéressons ici à l’apprentissage de représentations non distinctes qui codent des aspects distincts des données dans des variables distinctes. Nous proposons d’apprendre de telles représentations à l’aide d’architectures de modèle généralisées à partir de VAEs standards, en utilisant une structure de modèle graphique générale dans le codeur et le décodeur. Cela nous permet de former des modèles partiellement spécifiés reposant sur des hypothèses relativement solides concernant un sous-ensemble de variables interprétables et reposant sur la flexibilité des réseaux de neurones pour l’apprentissage des représentations des autres variables. Nous définissons en outre un objectif général pour l’apprentissage semi-supervisé dans cette classe de modèles, qui peut être approchée à l’aide d’une procédure d’échantillonnage en fonction de l’importance. Nous évaluons la capacité de notre cadre à apprendre des représentations non liées, à la fois par une exploration qualitative de sa capacité générative et une évaluation quantitative de sa capacité discriminante sur divers modèles et jeux de données.