Inference Compilation and Universal Probabilistic Programming

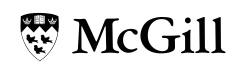

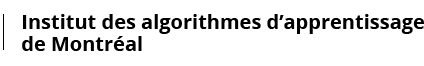

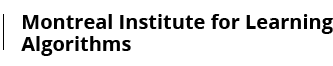

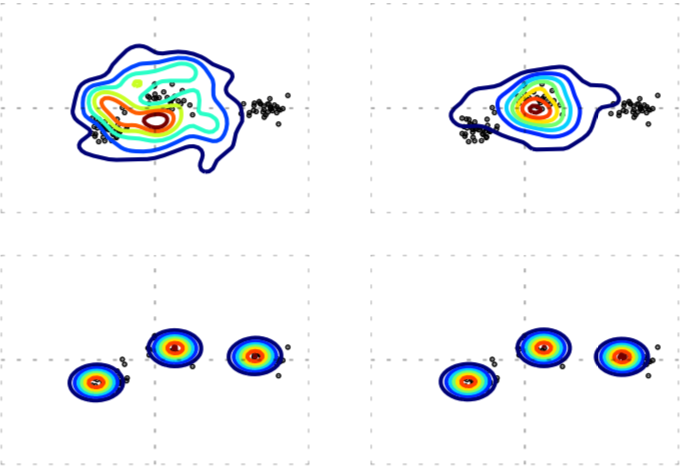

Nous introduisons une méthode d’utilisation de réseaux neuronaux profonds pour amortir le coût de l’inférence dans les modèles de la famille induits par les langages de programmation probabilistes universels, en établissant un cadre combinant les atouts de la programmation probabiliste et des méthodes d’apprentissage profond. Nous appelons ce que nous faisons «compilation d’inférence» car notre méthode transforme une spécification dénotationnelle d’un problème d’inférence sous la forme d’un programme probabiliste écrit dans un langage de programmation universel en un réseau neuronal formé au sein d’un langage de spécification de réseau neuronal. Lorsque, au moment du test, ce réseau de neurones est alimenté en données d’observation et exécuté, il effectue une inférence approximative dans le modèle d’origine spécifié par le programme probabiliste. Notre objectif de formation et notre procédure d’apprentissage sont conçus pour permettre au réseau de neurones formé d’être utilisé comme distribution de proposition dans un moteur d’inférence d’échantillonnage d’importance séquentielle. Nous illustrons notre méthode sur les modèles de mélange et la résolution de Captcha et montrons des améliorations significatives dans l’efficacité de l’inférence.